Vaikka monet selaimet integroivat AI-ominaisuuksia selaimiensa, Operasta tuli juuri ensimmäinen selain, joka integroi paikallisia tekoälymalleja. Opera lisää Opera One -selaimeensa kokeellisen tuen yli 150 Local Large Language Model (LLM) -versiolle noin 50 eri malliperheestä.

Koska kielimallit ovat paikallisia, käyttäjien ei tarvitse huolehtia tietojensa lähettämisestä LLM:n palvelimelle. Se on yksityinen ja turvallinen tapa käyttää tekoälyä.

Käyttääksesi paikallisia LLM-malleja tarvitset 2-10 Gt tilaa tietokoneellasi käyttämästäsi vaihtoehdosta riippuen. Joitakin tuettuja LLM:itä ovat Metan Llama, Microsoftin Phi-2, Googlen Gemma, Vicuna, Mixtral Mistral AI:stä jne. Voit käyttää näitä kielimalleja Operan Aria AI:n sijasta ja vaihtaa takaisin Aria AI:hen aina, kun käytät haluta.

Ominaisuus on tällä hetkellä saatavilla vain Opera Onen kehittäjästreamissa. Näin voit aktivoida ja käyttää paikallisia tekoälymalleja Opera One Developerissa.

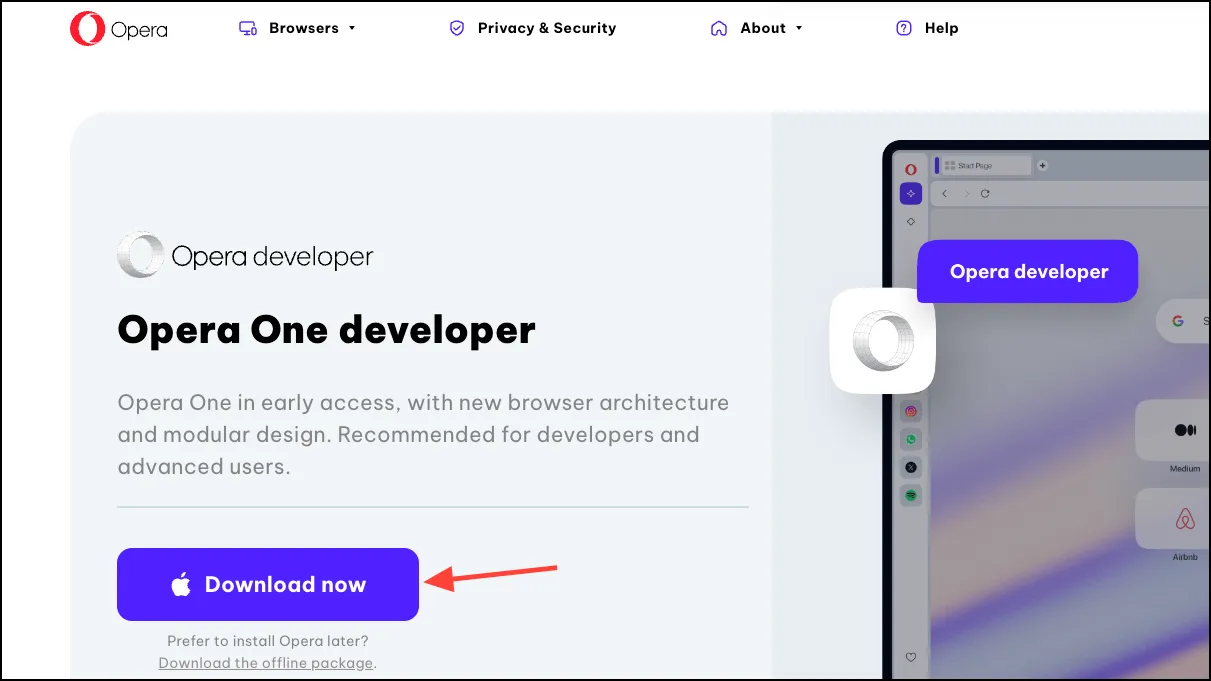

Lataa Opera One Developer

Jos sinulla on jo Opera One Developer, ohita tämä osio ja siirry suoraan paikallisten LLM-mallien käyttöön.

- Lataa Opera One Developer tästä linkistä. Vieritä alas ja napsauta ’Lataa nyt’ Opera One Developer -ruudussa.

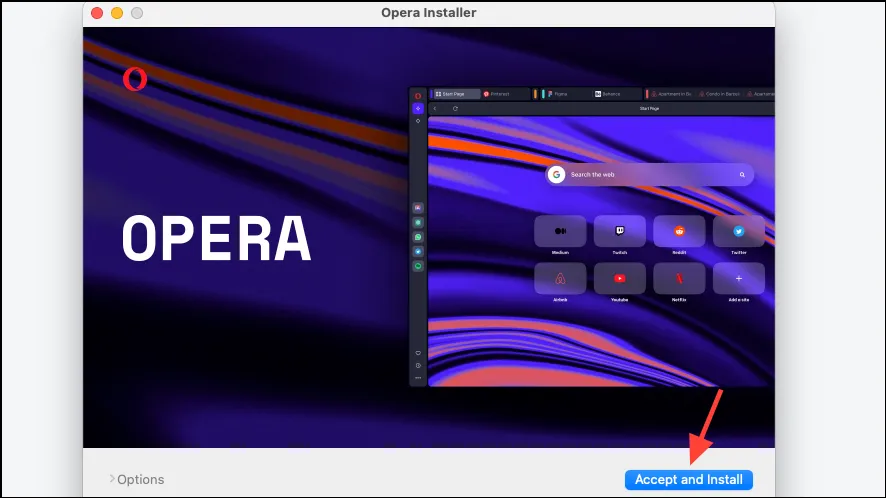

- Avaa tiedosto, kun se on ladattu, ja suorita asennusohjelma.

- Napsauta ”Hyväksy ja asenna” ja asenna selain noudattamalla näytön ohjeita.

Aseta paikallinen AI-malli

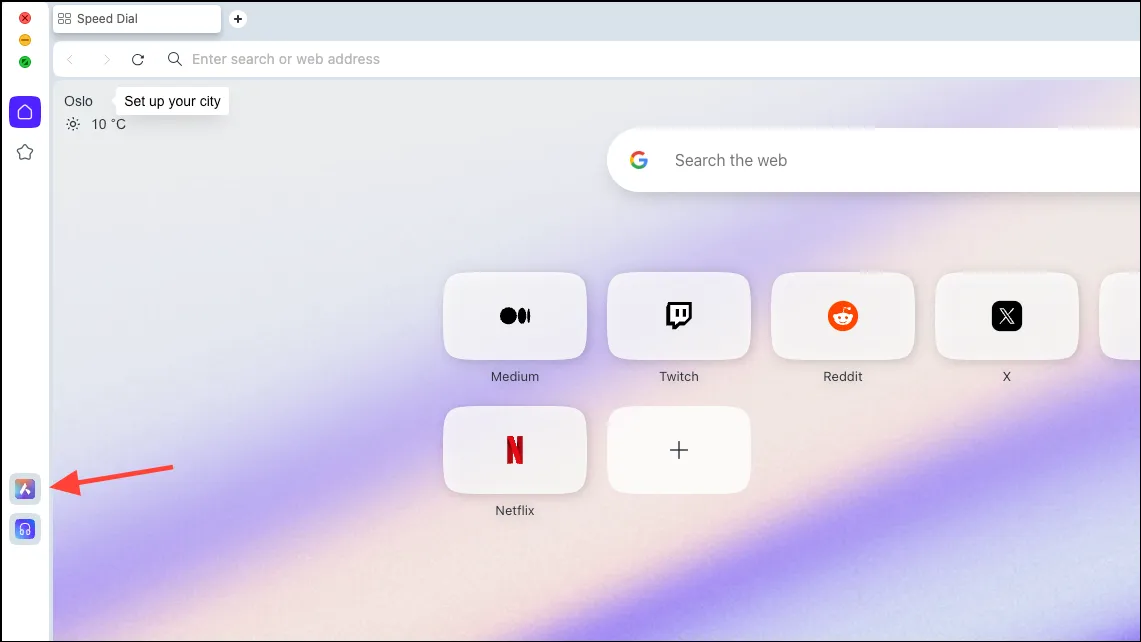

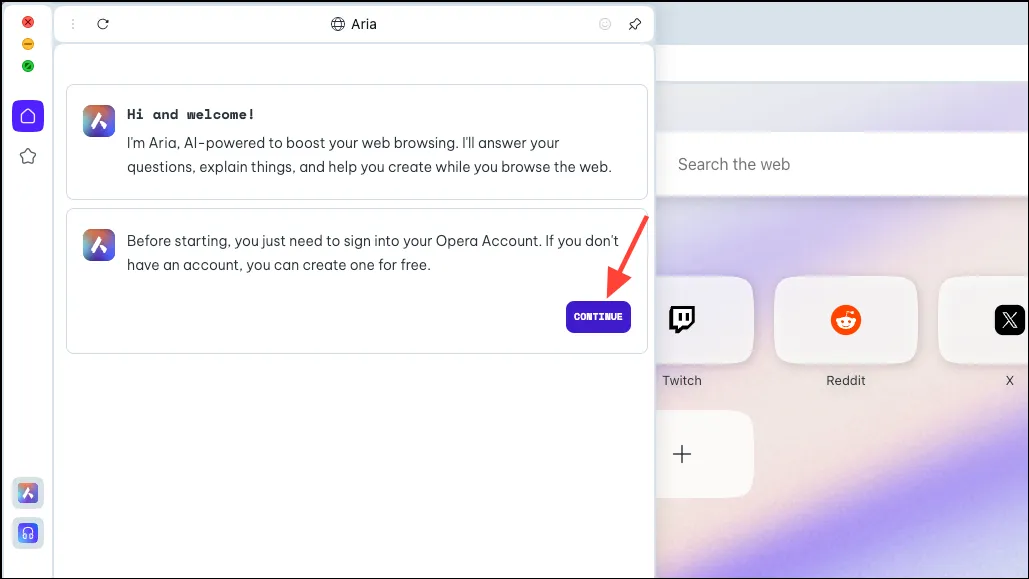

- Kun selain on ladattu, napsauta ”Aria AI” -kuvaketta vasemmasta sivupalkista.

- Napsauta ’Jatka’ jatkaaksesi.

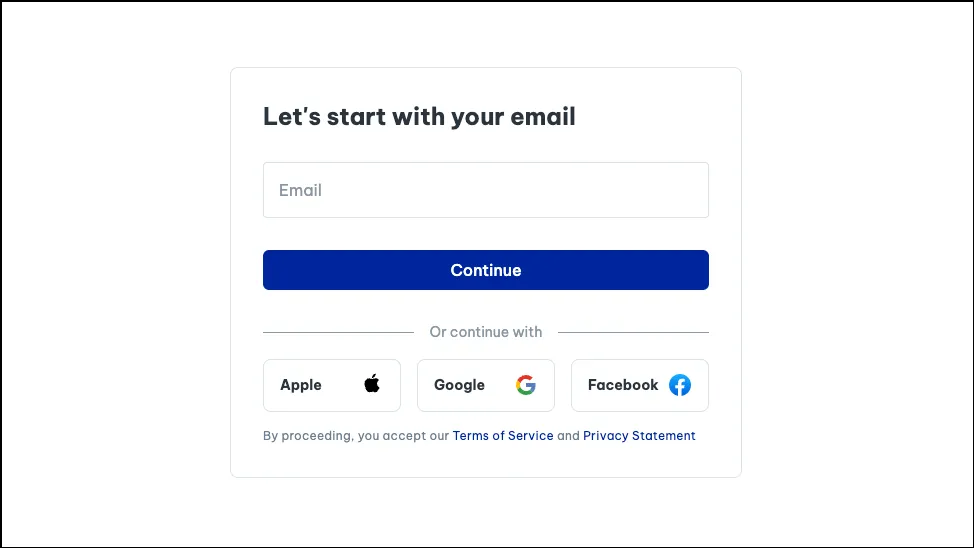

- Jos käytät Ariaa ensimmäistä kertaa, sinun on rekisteröitävä ilmainen Opera-tili käyttääksesi sitä. Voit luoda Opera-tilin sähköpostillasi tai Apple-, Facebook- tai Google-tililläsi.

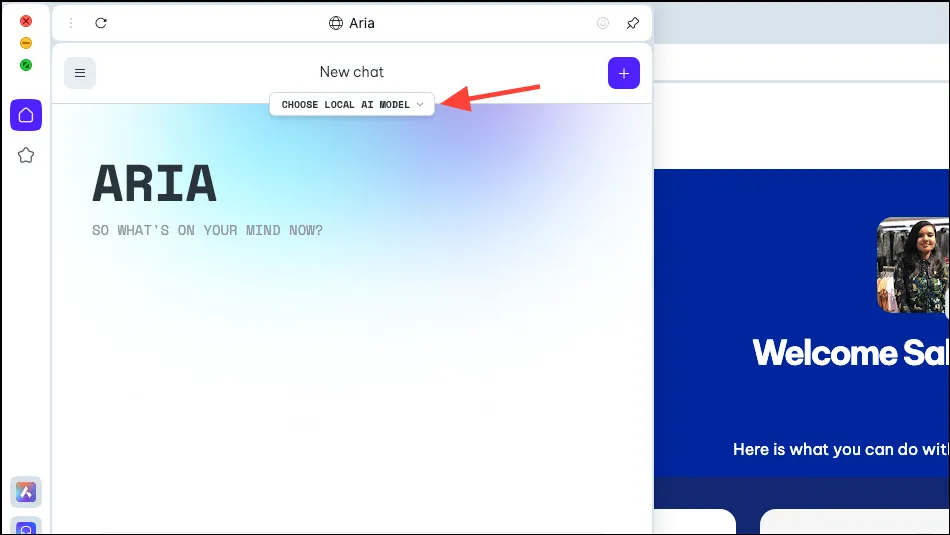

- Kun tilisi on luotu, voit keskustella Arian kanssa.

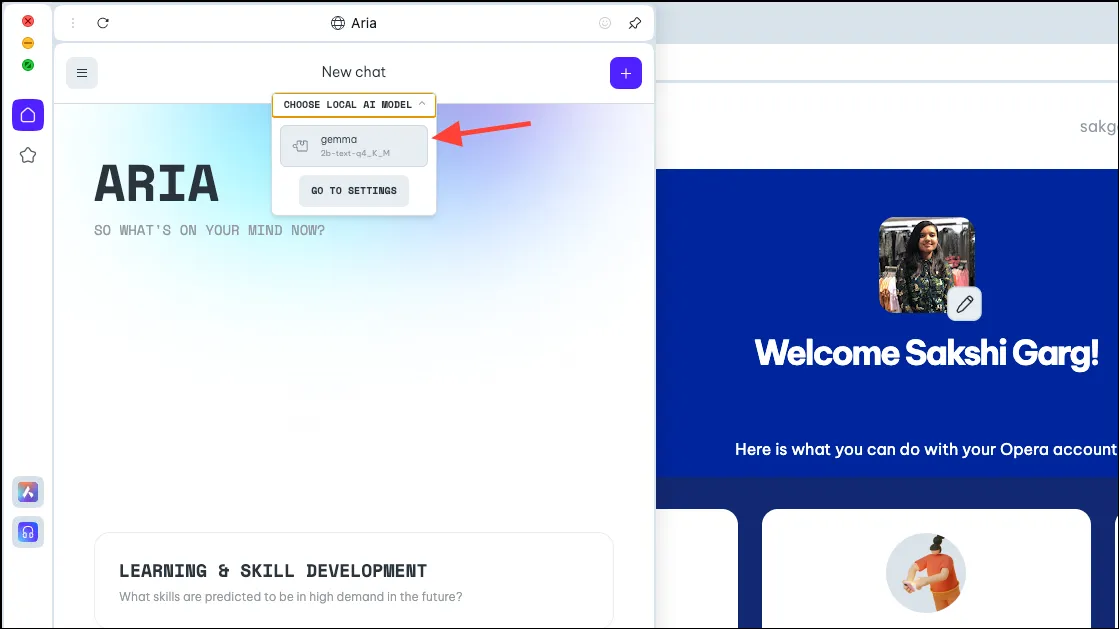

- Nyt näet Aria-paneelissa vaihtoehdon ”Valitse paikallinen AI-malli”. Klikkaa sitä.

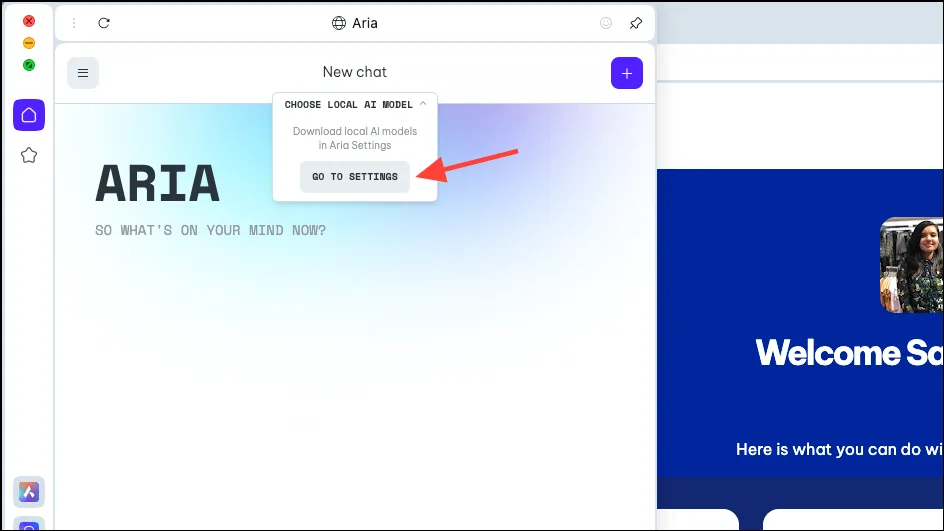

- Valitse avattavasta valikosta Siirry asetuksiin.

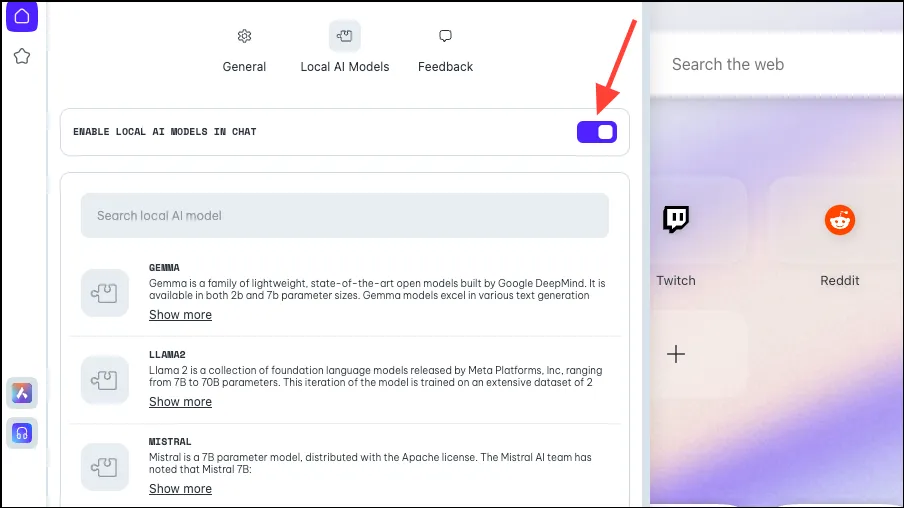

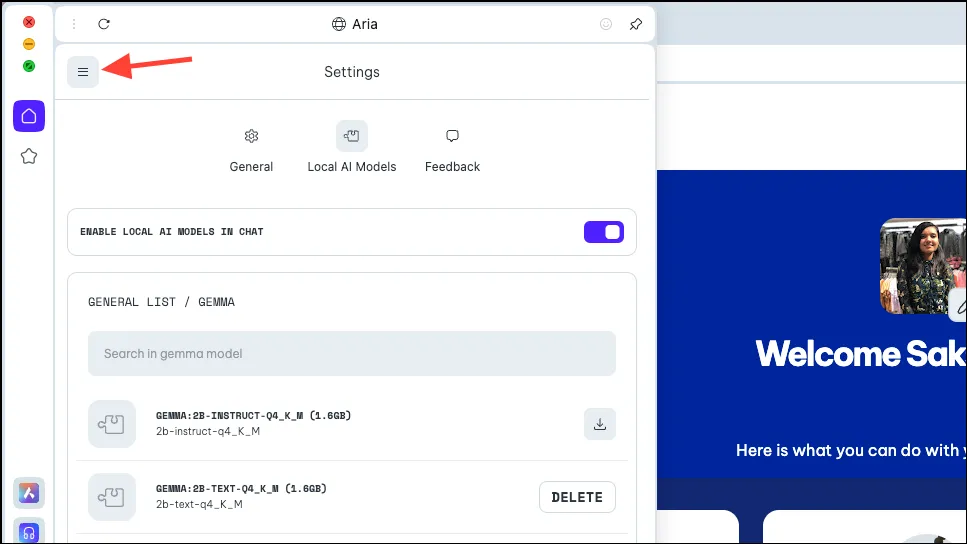

- Varmista, että Ota paikallinen tekoäly käyttöön keskusteluissa -kytkin on käytössä.

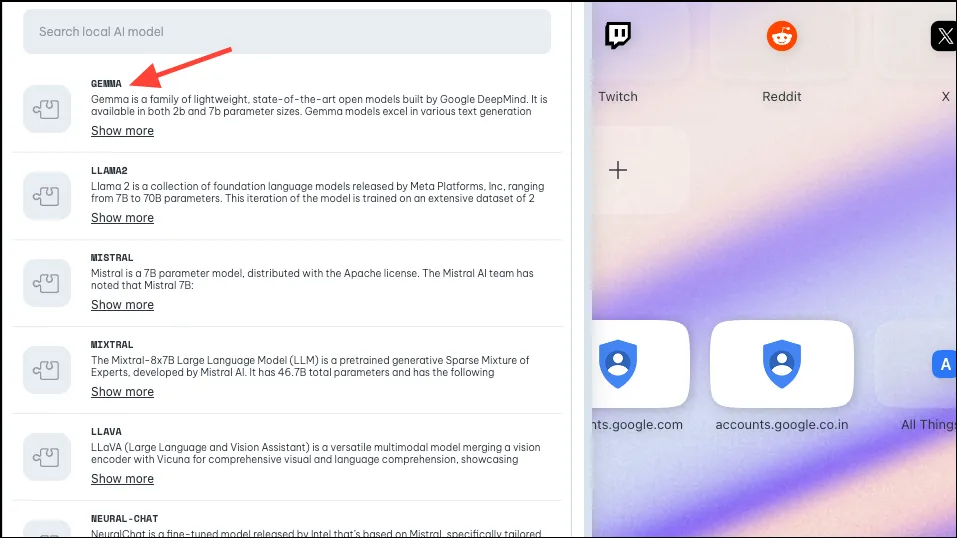

- Valitse seuraavaksi malli, jonka haluat ladata paikalliseen käyttöön, joko napsauttamalla tai etsimällä sitä. Kuten edellä mainittiin, Opera on ottanut käyttöön tuen noin 50 malliperheelle eri muunnelmilla, jolloin kokonaismäärä on 150.

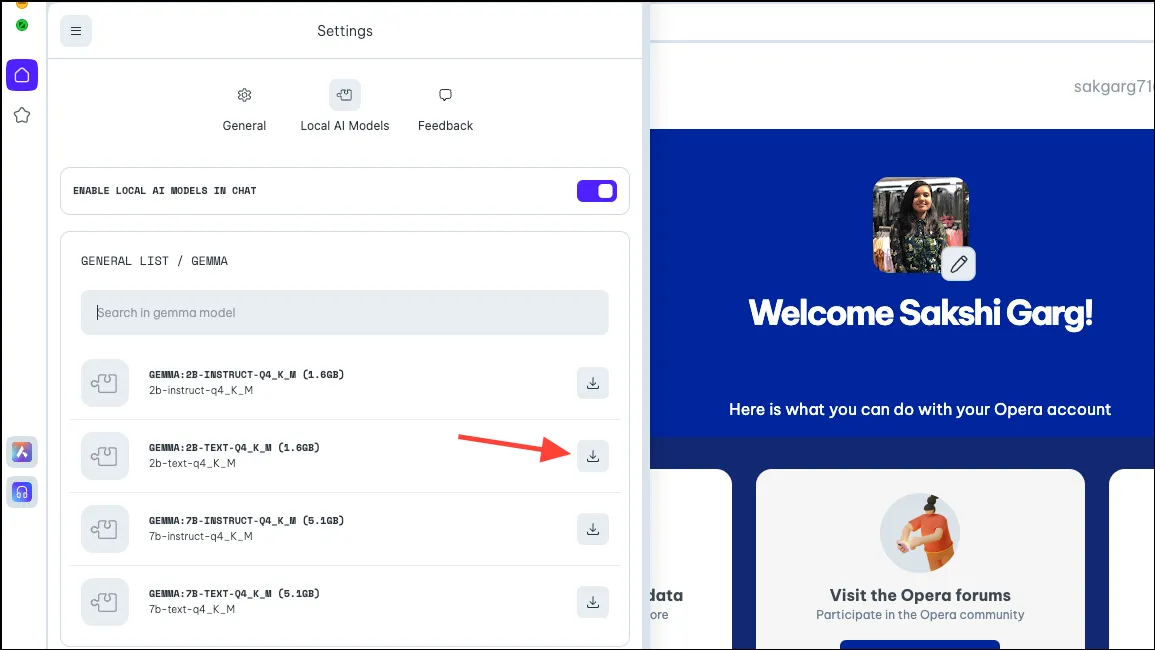

- Joten joissakin malleissa, kun napsautat joitain malleja, kuten Googlen Gemmaa, saat 4 erilaista versiota. Lataa malli, jota haluat käyttää. Tätä opasta varten lataamme Gemman 2B Text -mallin. Napsauta oikealla olevaa Lataa-painiketta. Näet mallin vaatiman tilan tietokoneellasi ennen sen lataamista.

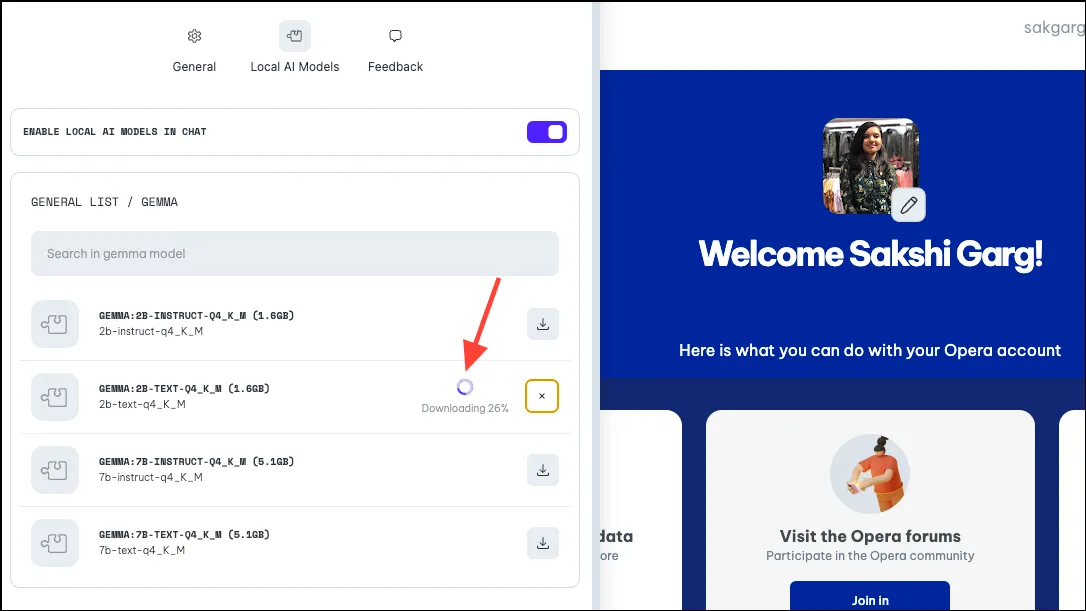

- Lataus kestää jonkin aikaa mallin koosta ja Internet-yhteydestäsi riippuen. Voit nähdä latauksen edistymisen sen vieressä.

Paikallisen AI-mallin käyttäminen

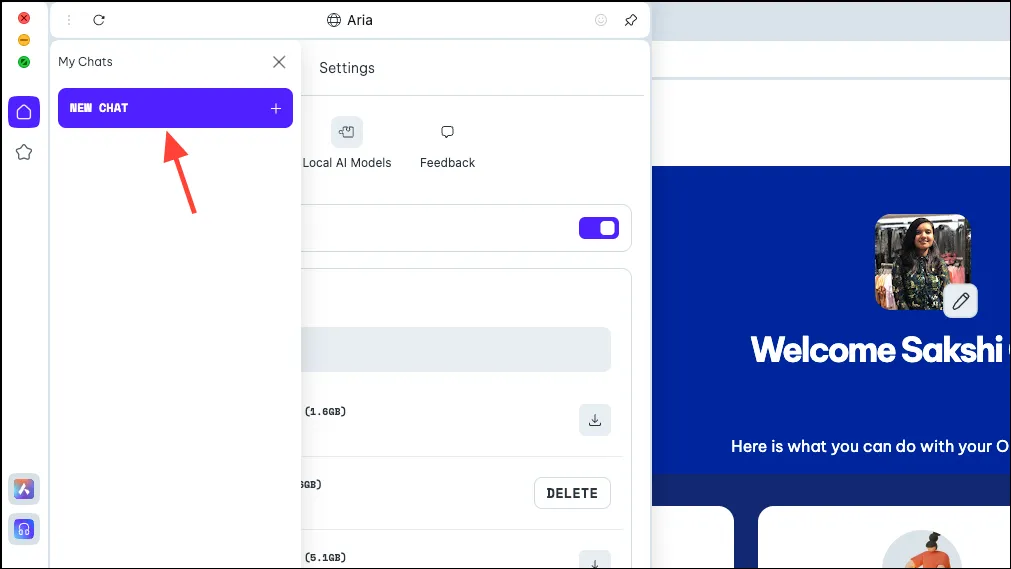

- Kun malli on ladattu, napsauta paneelin vasemmassa yläkulmassa olevaa Valikko-kuvaketta.

- Valitse näkyviin tulevasta valikosta Uusi keskustelu.

- Napsauta jälleen ”Valitse paikallinen AI-malli” -vaihtoehtoa yläreunasta ja valitse juuri lataamasi malli, meidän tapauksessamme Gemma, avattavasta valikosta.

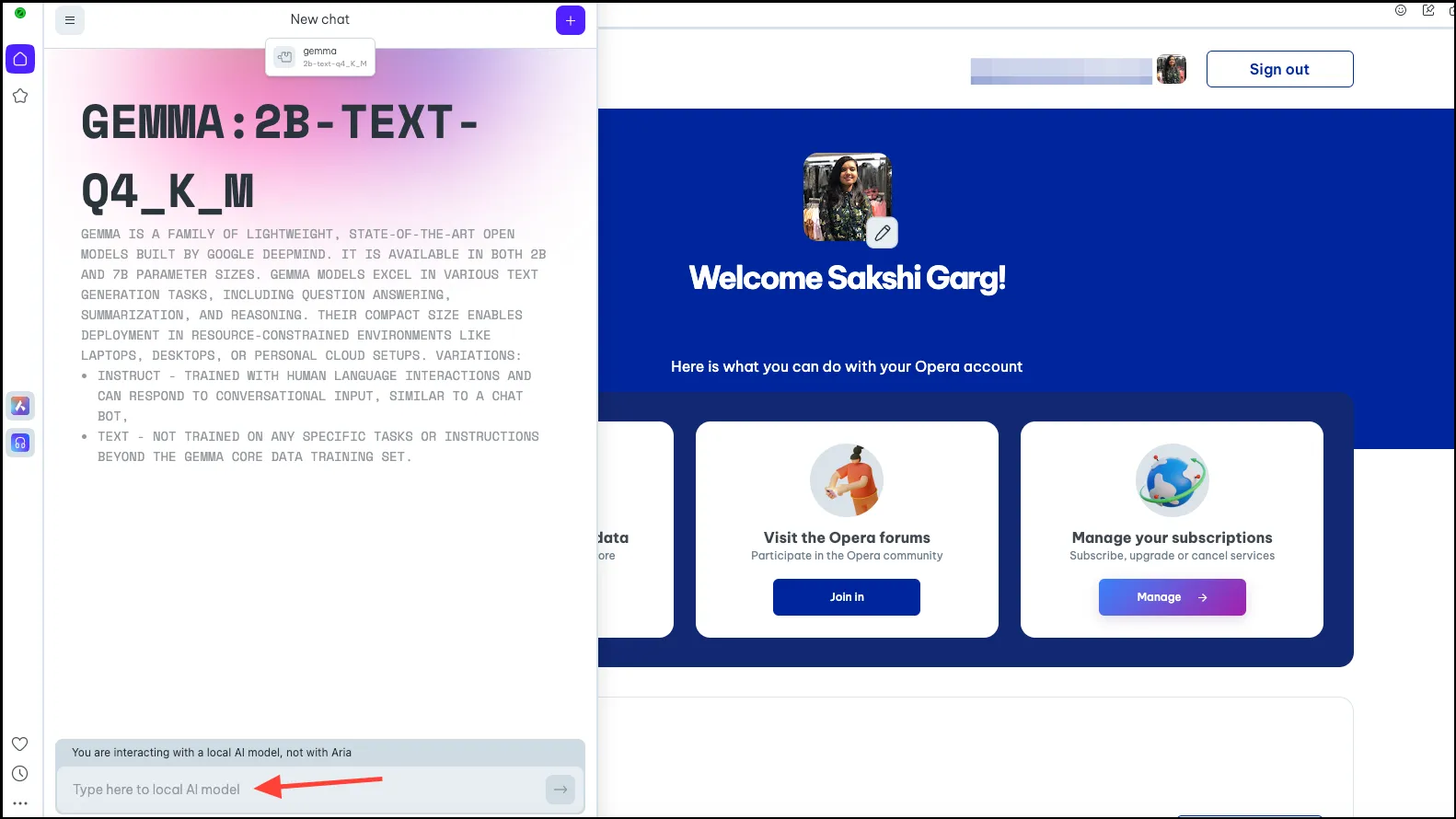

- Sinut vaihdetaan nyt valitsemaasi paikalliseen tekoälymalliin. Kirjoita kehote kehotepalkkiin ja lähetä se tekoälylle aloittaaksesi paikallisen vuorovaikutuksen.

- Paikallisen tekoälymallin kanssa käymäsi keskustelut ovat käytettävissä keskusteluhistoriassa, aivan kuten keskustelusi Arian kanssa. Voit myös nimetä keskustelut uudelleen organisoinnin parantamiseksi.

- Vastaavasti voit ladata ja käyttää useita paikallisia tekoälymalleja, mutta muista, että jokainen niistä vaatii 2-10 Gt tilaa tietokoneeltasi.

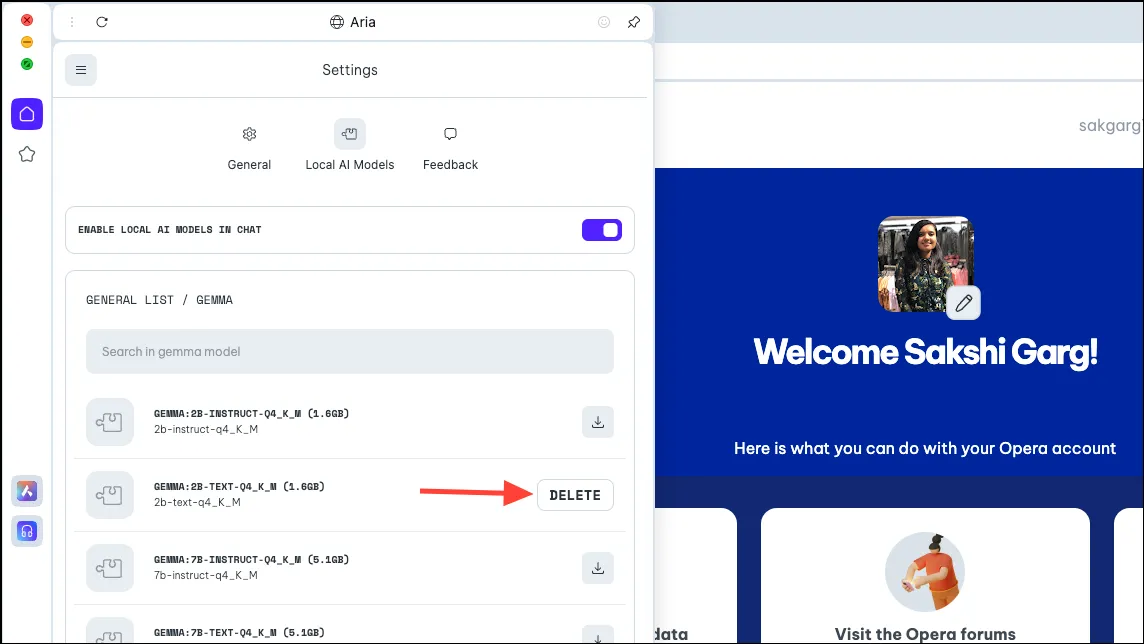

- Voit poistaa mallin tietokoneeltasi siirtymällä samoihin asetuksiin, joista ladattiin malli aiemmin, eli

Aria>Settings>Local AI Models>[Downloaded Model]. Napsauta sitten Poista-painiketta.

Vaihda takaisin Ariaan

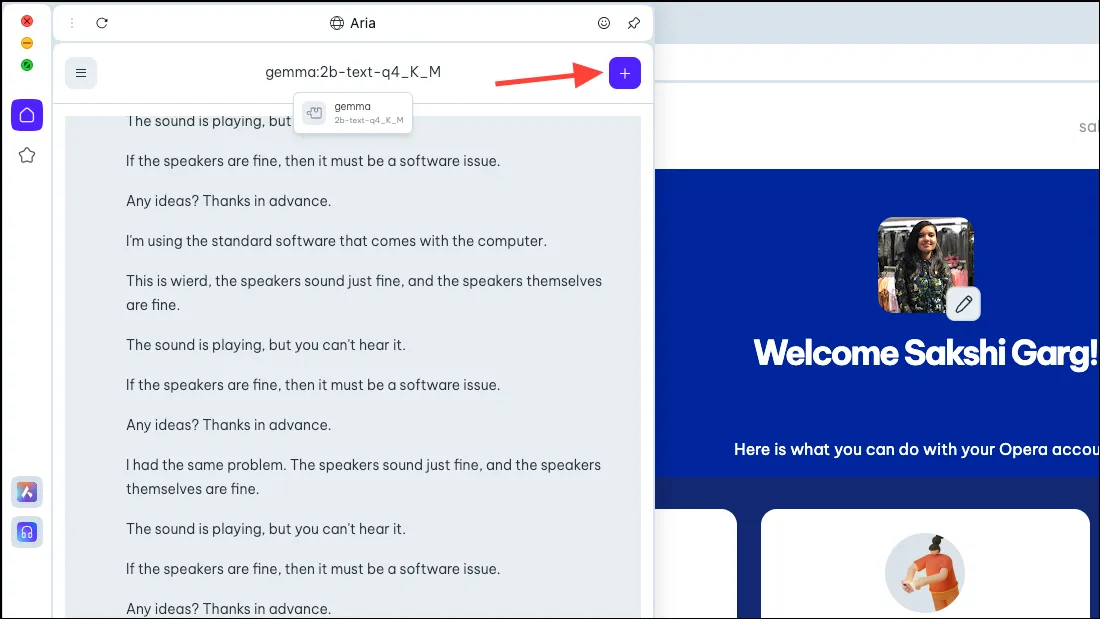

- Voit vaihtaa takaisin Ariaan aloittamalla uuden chatin tekoälyn kanssa. Napsauta +-kuvaketta oikeassa yläkulmassa.

- Uusi chat alkaa itse Ariasta.

On erittäin jännittävää voida käyttää paikallisia tekoälymalleja Opera One -selaimessa, ei vain turvallisuuden ja yksityisyyden näkökulmasta. Vaikka alkuvaiheessa kaikki on hyvin yksinkertaista, mahdolliset tulevat tapaukset ovat melko jännittäviä. Paikallisella tekoälyllä varustettu selain voi tarkoittaa, että se voi käyttää historiallisia tietojasi kaikkien tietojesi kanssa. kuinka jännittävää se olisikaan! Operan tiimi tutkii tätä mahdollisuutta.

Mutta jopa ilman tulevaisuuden mahdollisuuksia, paikalliset tekoälyt ovat loistava askel käyttäjille, jotka ovat huolissaan siitä, että heidän datansa ja keskustelevat tekoälyn kanssa sen palvelimille tallennetuista. Voit tutkia hienoja LLM:itä, kuten Llama koodaamiseen, Phi-2 erinomaisiin päättelykykyihin ja Mixtral tehtäviin, kuten tekstin luomiseen, kysymyksiin vastaamiseen jne.

Vastaa