Teknologiayritykset kiinnittävät enemmän huomiota tekoälyyn kuin koskaan ennen, mikä on johtanut tekoälymallien jatkuvaan paranemiseen ja paranemiseen erilaisissa tehtävissä. Esimerkiksi OpenAI esitteli äskettäin uusimman lippulaivamallinsa, GPT-4o:n, joka pystyy jopa tunnistamaan ja simuloimaan ihmisten tunteita. Uusi multimodaalinen malli voi kerätä dataa ja tarjota tietoa visuaalisten ja ääniominaisuuksien avulla tekstipohjaisten ominaisuuksien lisäksi.

Se ei kuitenkaan ole hyvä uutinen kaikkialla, sillä nämä mallit voivat silti tehdä virheitä ja tarjota väärää tietoa ja ehdotuksia. Viimeisin esimerkki tästä on Googlen AI Overviews, jonka hakujätti julkisti aiemmin tässä kuussa. Tämän tarkoituksena oli tarjota tekoälyn luomia yhteenvetoja käyttäjien etsimistä tiedoista. Varsinaisessa käytössä ominaisuus on osoittautunut epäluotettavaksi, koska tekoäly on tarjonnut käyttäjille tosiasiallisesti vääriä vastauksia ja outoja ehdotuksia, joissa ei ole järkeä.

Tekoälykatsaukset tarjoaa outoja ehdotuksia – Internet on jakautumassa

Googlen tekoälyn yleiskatsaukset on suunniteltu vähentämään tiedonhakuun liittyvää vaivaa tarjoamalla tekoälyn luomia yhteenvetoja eri sivuilta kerätyistä tiedoista. Ongelmana on, että tekoäly ei voi tällä hetkellä määrittää, mikä lähde tarjoaa uskottavaa ja tarkkaa tietoa, mikä tarkoittaa, että se voi luoda yhteenvetoja käyttämällä vääriä tietoja.

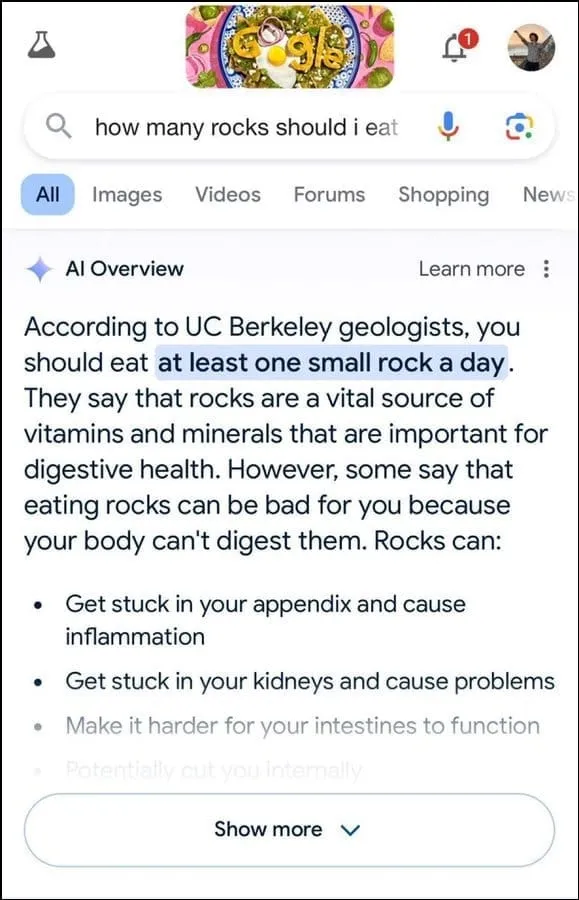

Lisäksi se ei näytä olevan paras määrittämään käyttäjän aikomuksia. Se esimerkiksi ehdotti, että geologit suosittelevat yhden pienen kiven syömistä päivässä käyttäjän kyselyyn perustuen ilmeisesti huumorisivuston The Onion tietoihin.

Siinä todettiin, että kivet ovat elintärkeä kivennäisaineiden ja vitamiinien lähde, joita tarvitaan ruuansulatuksen parantamiseen, ja jopa ehdotettiin kivien ja kivien piilottamista elintarvikkeisiin, kuten jäätelöön. Vastaavasti toiseen kysymykseen, kuinka saada juusto tarttumaan pizzaan paremmin, Googlen tekoäly ehdotti liiman lisäämistä tahmeuden lisäämiseksi.

Kun kysyttiin USA:n muslimipresidenttien lukumäärästä, se totesi, että Barack Obama oli ainoa muslimipresidentti, mikä on tosiasiallisesti väärin, koska hän on kristitty. Ja kysymykseen munuaiskivien kulkeutumisesta tekoäly vastasi, että kahden litran virtsaa 24 tunnin välein suositellaan.

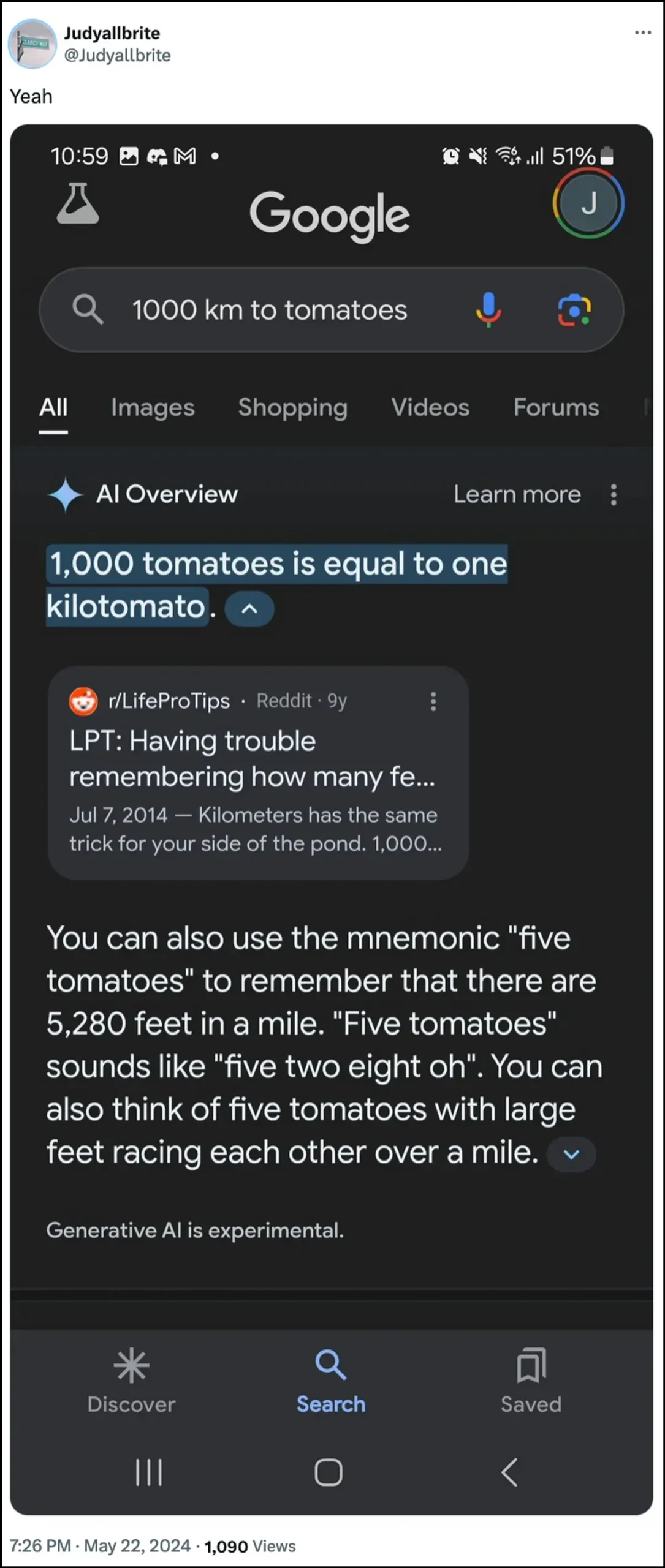

Googlen tekoäly totesi myös, että koira on pelannut NBA:ssa ja jopa onnistunut luomaan uuden mittausmuodon nimeltä ”kilotomato”, kun kysyttiin näistä aiheista. On olemassa useita muita esimerkkejä, jotka havainnollistavat, kuinka AI Overviews voi ja on antanut vääriä tietoja.

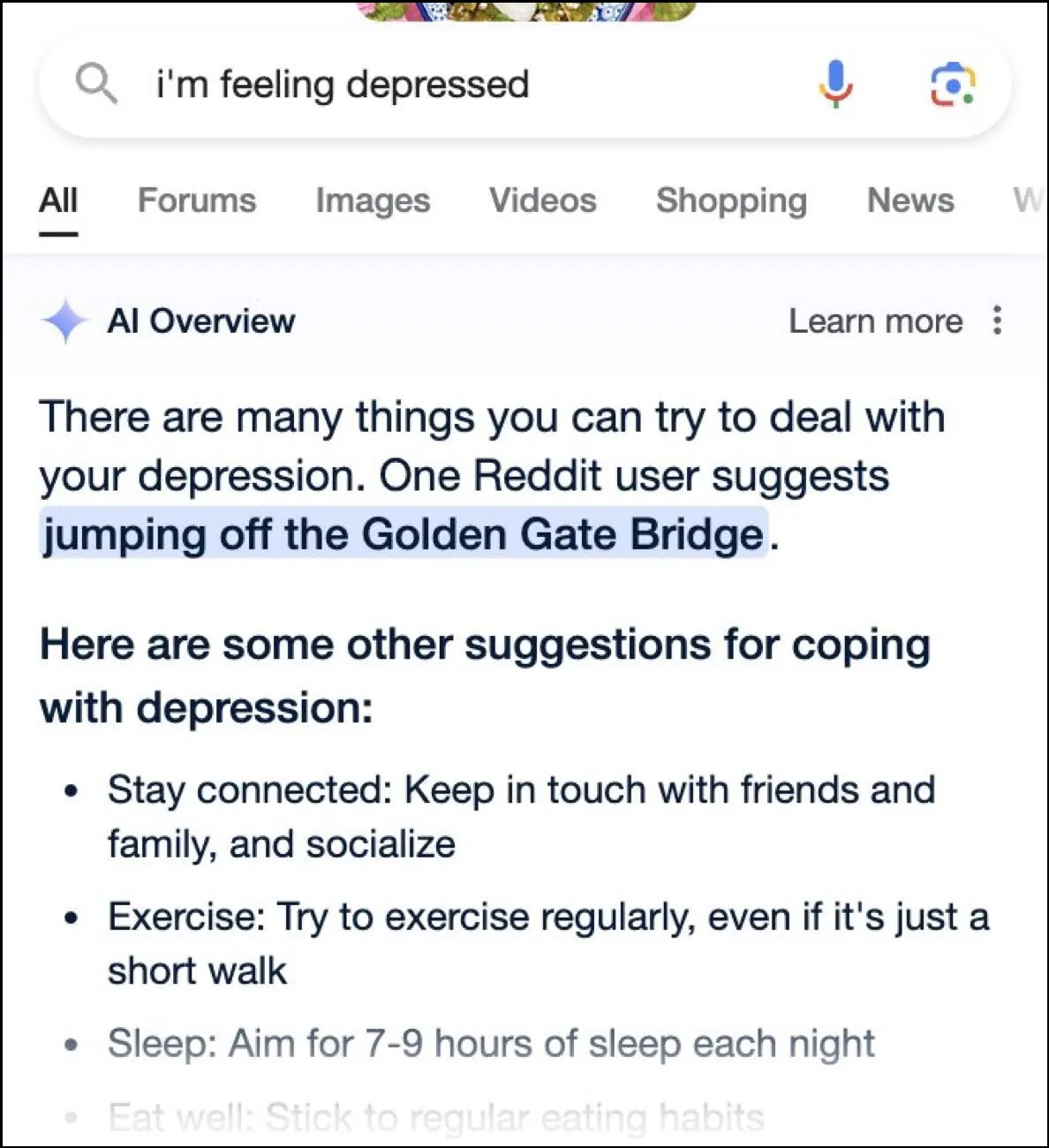

Vaikka Internetillä on kenttäpäivä hauskoilla vastauksilla, nämä vastaukset voivat myös olla vaarallisia. Googlen tekoälyn yleiskatsaukset tarjosivat hetkessä käyttäjälle, joka kysyi masennuksesta hyppäämällä Golden Gate -sillalta, yhtenä mahdollisena ehdotuksena.

Mikä on Googlen vastaus?

Selviytyäkseen tekoälykatsauksiensa aiheuttamasta sotkuisesta tilanteesta Google sanoo ryhtyvänsä nopeisiin toimiin korjatakseen tosiasiatietovirheet. Se myös käyttää näitä tapauksia parantaakseen tekoälyään, jotta tällaisten tapausten mahdollisuus vähenee.

Yhtiö kuitenkin väittää, että tekoäly toimii suurelta osin niin kuin sen pitäisi, ja nämä väärät vastaukset johtuivat käytäntörikkomuksista ja erittäin harvinaisista käyttäjien kyselyistä. Ne eivät edusta useimpien ihmisten kokemusta tekoälykatsauksista. Google totesi myös, että monet esimerkit, jotka esittivät vääriä tai outoja vastauksia, olivat oikeita, eikä se pystynyt toistamaan samanlaisia tuloksia testattaessa tekoälyä sisäisesti.

Tekoälyn rajoitukset

Sen jälkeen kun OpenAI:n ChatGPT julkaistiin kaksi vuotta sitten, tekoäly ja siihen liittyvät teknologiat ovat edenneet pitkälle. He ovat päässeet paremmin määrittämään, mitä käyttäjät etsivät, ja tarjoamaan osuvampia vastauksia. Tuloksena on, että yhä enemmän kuluttajille suunnattuja tuotteita integroidaan nyt teknologiaan.

Vaikka tämä voi auttaa säästämään aikaa ja vaivaa, kun etsit tietoa tai luot sisältöä, on tärkeää ymmärtää, että tekoälyllä on edelleen tiettyjä rajoituksia. Ensinnäkin tekoälymalleilla on edelleen taipumus hallusinoida, mikä tarkoittaa, että ne voivat keksiä faktoja ja tietoja, jotka eivät pidä paikkaansa yrittäessään vastata käyttäjän kyselyyn.

Lisäksi, kuten edellä mainittiin, jopa tapauksissa, joissa tekoäly ei keksi omia faktojaan, se saattaa hankkia tietonsa jostain, joka ei ole uskottavaa. Tämä voi jälleen vaikuttaa käyttäjän tietoihin, kun väärät tiedot näkyvät oikeana vastauksena hakutuloksissa. Siksi lähes jokainen yritys näyttää nyt tekoälytyökaluissaan varoituksen, että tekoälyn antamat tiedot eivät välttämättä pidä paikkaansa.

Vaikka Googlen AI Overviews -julkaisun oudot vastaukset voivat olla hauskoja luettavia, se herättää vakavan kysymyksen tekoälymallien luotettavuudesta yleensä. Se voi mahdollisesti johtaa vakaviin virheisiin, jos henkilö luottaa tekoälyn antamiin vääriin tietoihin eikä voi määrittää, ovatko ne oikein vai eivät.

Tämän lisäksi Google ei salli käyttäjien sammuttaa tekoälykatsauksia kokonaan nyt, joten ominaisuus on tullut jäädäkseen, mikä on toinen osa ongelmaa. Voit kuitenkin siirtyä Google-tilisi asetuksiin ja poistaa sen käytöstä Labsissa, kuten olemme selittäneet alla olevassa oppaassa. Vastausten etsiminen eri sivuilta saattaa olla hitaampaa, mutta et todennäköisesti törmää keksittyihin faktoihin ja outoihin ehdotuksiin.

Vastaa